告别云端延迟:NexaSDK 如何重新定义端侧推理?

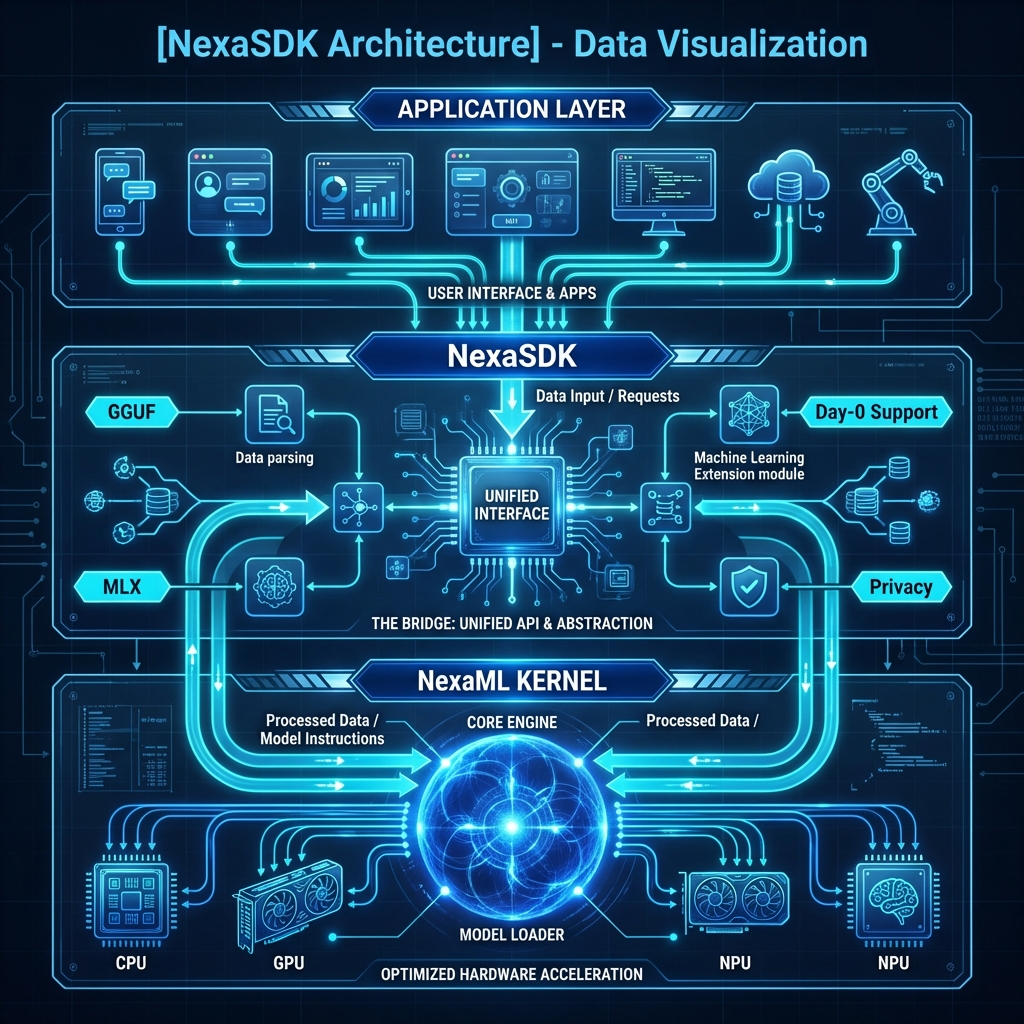

💡 核心摘要:NexaSDK 不仅仅是一个 Runtime 包装器,它是基于自研 NexaML 内核构建的完整工具包,能够让 GGUF、MLX 及多模态模型在 NPU/GPU/CPU 上实现 Day-0 级别的原生支持。

在端侧 AI 爆发的今天,开发者面临着巨大的碎片化挑战:不同的硬件栈(NPU, GPU, CPU)、繁杂的模型格式、以及对云端 API 的依赖。

今天,我们介绍 NexaSDK —— 一个从内核层面重构的端侧 AI 解决方案。

01. 什么是 NexaSDK?

NexaSDK 是一个易于使用的开发者工具包,旨在让任何 AI 模型在任何本地后端上运行。

与市面上常见的“套壳”Runtime 不同,NexaSDK 的底层动力源自 NexaML 引擎。这是一个完全从零构建的推理引擎,专为异构硬件栈的极致性能而生。

Why it matters?

传统的解决方案往往依赖于现有的运行时环境,而 NexaSDK 选择了一条更艰难但更彻底的道路:Kernel-Level Optimization(内核级优化)。

这意味着:

- 极致性能:直接压榨硬件潜力,无论是手机 NPU 还是 IoT 设备的 CPU。

- Day-0 支持:能够第一时间支持最新的模型架构,包括 LLM(大语言模型)、Multimodal(多模态)、Audio(音频)和 Vision(视觉)模型。

02. 全面支持主流格式

开发者无需进行繁琐的模型转换,NexaSDK 原生支持三大主流生态格式:

- GGUF:广泛使用的量化模型格式。

- MLX:Apple Silicon 生态的高效格式。

- .nexa:Nexa AI 自研的高效格式。

03. 真正的“本地优先”

使用 NexaSDK,你可以构建完全离线的 AI 应用:

- 隐私安全:数据不出设备。

- 零延迟:没有网络请求的往返耗时。

- 零成本:无需支付昂贵的云端 Token 费用。

立即开始

访问 NexaAI GitHub 获取 SDK,让你的设备拥有真正的智能核心。