Dev 2.0:还没在 IDE 里用自然语言「装技能」?你正在错过 AI 时代的 npm install

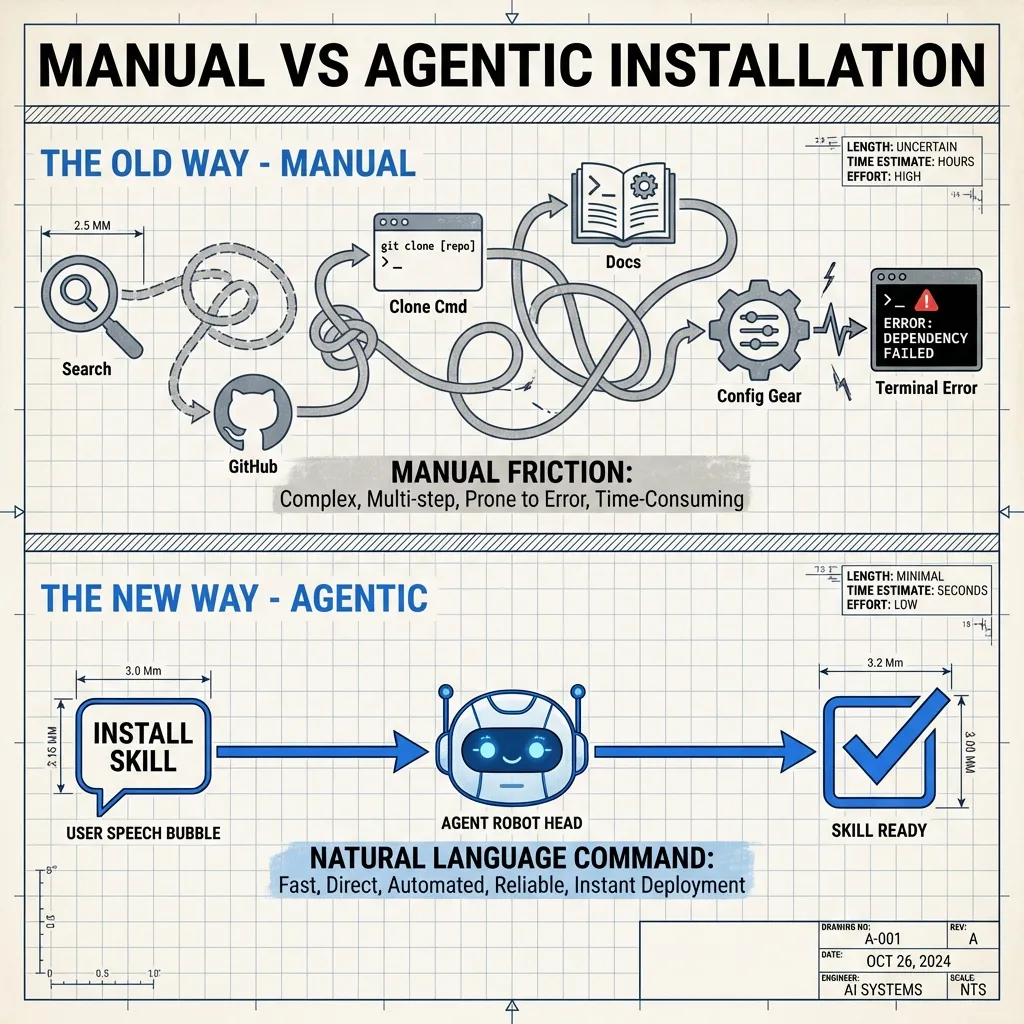

作为开发者,我们都习惯了这样的肌肉记忆:

遇到需求 -> 搜索 GitHub -> git clone -> 阅读 README.md -> 配置环境 -> npm install -> 调试报错…

但在 Google Antigravity 这样的大模型原生开发环境中,这个流程正在被彻底重构。 最近我发现,很多开发者虽然用上了 AI 补全代码,却还没掌握 “Agentic Skills” (代理技能) 的正确打开方式。

今天这篇,不谈具体的代码细节,我们来聊聊:如何用自然语言,给你的 AI 结对编程伙伴「安装大脑」。

🚀 什么是 Skill?不仅是代码库

在 Antigravity 的语境下,Skill 不仅仅是一个 GitHub 仓库。它是 代码 + 知识 + 执行逻辑 的封装。 当你说 “安装这个 Skill” 时,你不仅是在下载文件,你是在教 Agent:

- 怎么做 (Scripts/Tools)

- 什么时候做 (Triggers)

- 遵循什么标准 (Best Practices)

🗣️ Step 1: 用自然语言替代包管理器

以前我们需要自己判断 “这个库兼容吗?” “怎么配置依赖?”。 现在,只需要一句话:

User: “帮我安装

appstore-screenshot-generator这个 skill,我想给我的 App 自动生成营销图。”

Agent 做了什么?

- 环境感知:它知道你的项目是 iOS/SwiftUI 项目,知道 Python 环境在哪。

- 自动安装:它自动拉取代码,把工具链部署到

.gemini/skills/目录下。 - 依赖管理:发现缺少

Pillow库?它自动检测并提示安装,甚至直接帮你跑pip install。

你不需要离开编辑器,不需要打开终端敲命令,你的意图直接转化为了能力。

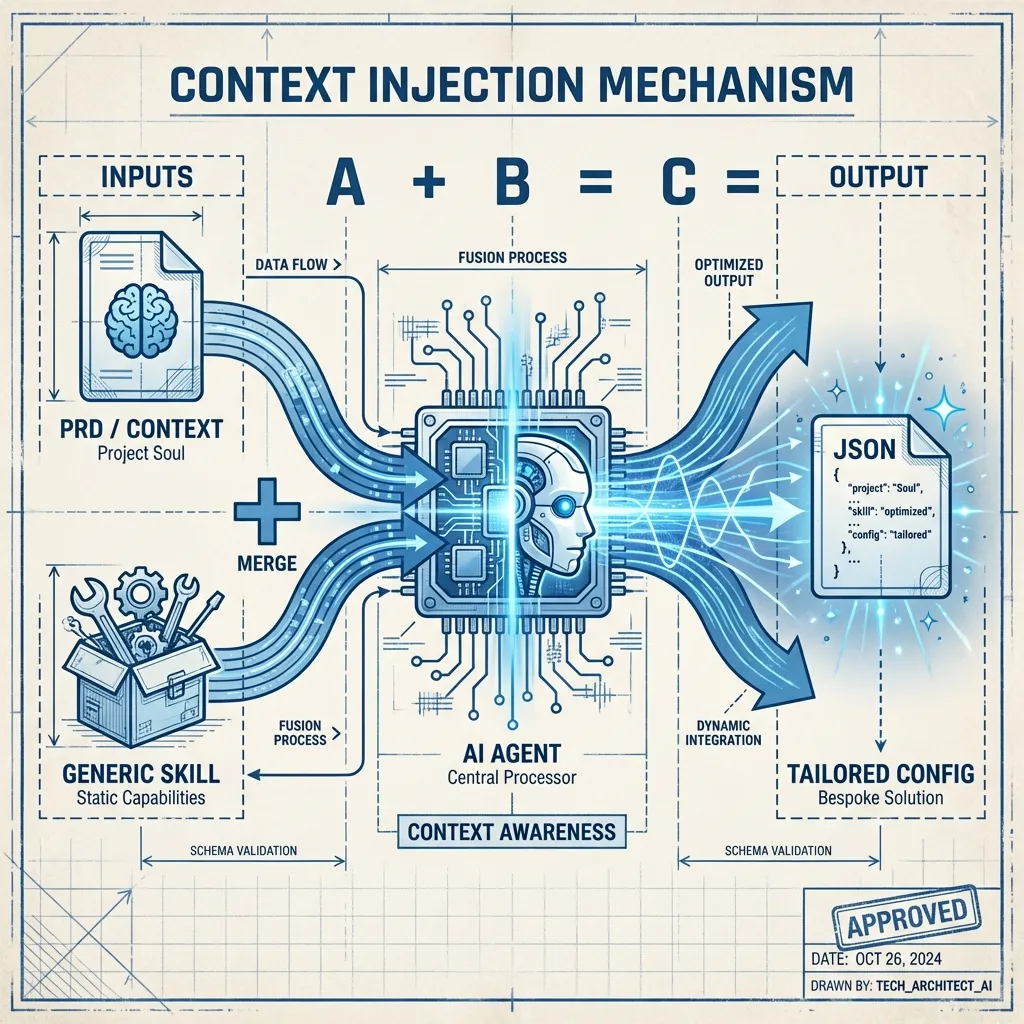

🧠 Step 2: 上下文注入 —— 让 Skill “懂” 你的产品

这是最 “Magic” 的一步。

传统的工具是死的,你必须手动填写 config.json。

但 Agent 是活的,它拥有你整个项目的上下文 (Context)。

User: “读取我的

PRD.md,用这个 Skill 生成 iPad mini 的截图配置。注意,我的产品核心价值是’思维整理’。”

发生了什么?

- 阅读理解:Agent 读懂了 PRD,提炼出 “Speak to Clarify” 的核心卖点。

- 跨界映射:它把 PRD 里的 “产品定位” 自动翻译成了 JSON 里的

title和tagline。 - 自动配置:它根据你的项目结构(

marketing/目录),自动填好了文件路径。

你得到的不是一个空的配置文件,而是一个填满了你产品灵魂的配置。

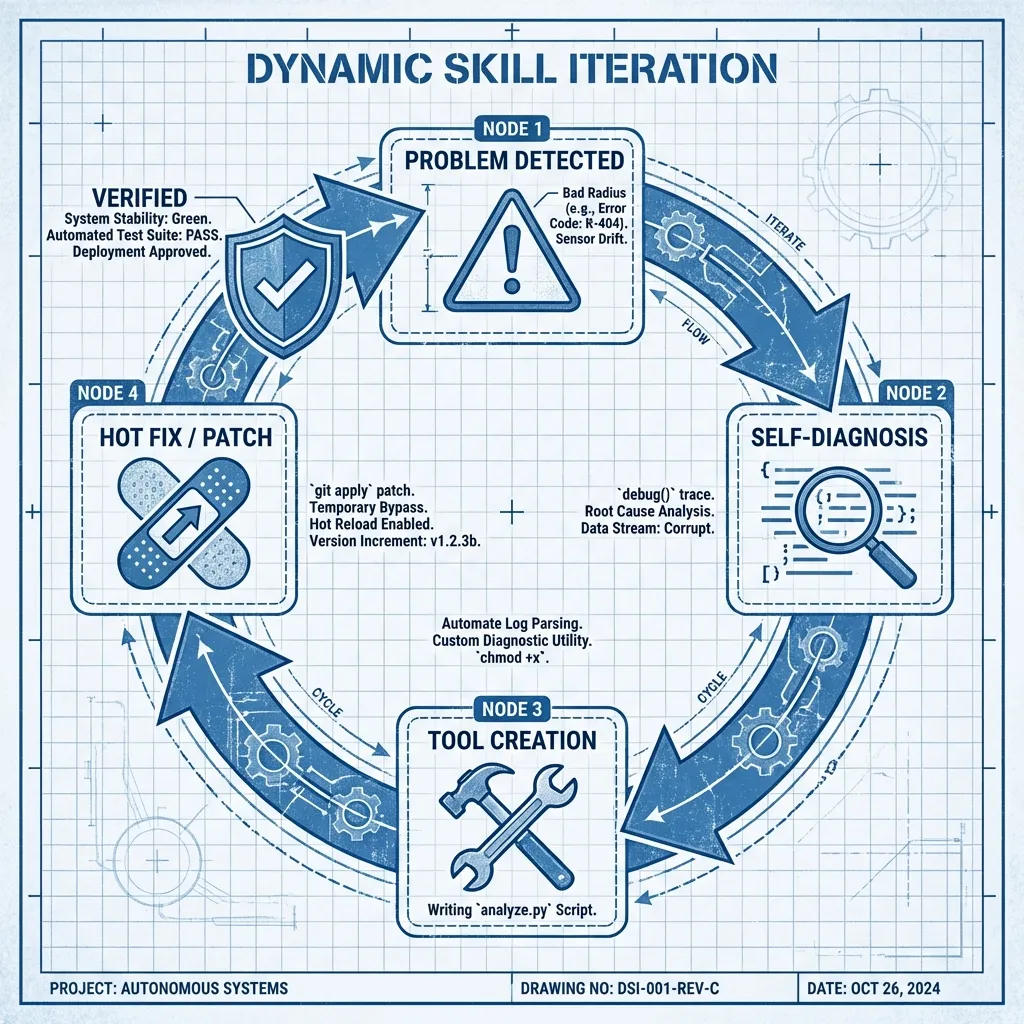

🔧 Step 3: 动态迭代 —— 当 Skill 不够用时

现成的 Skill 总有不完美的地方。比如,iPad mini 的圆角和 iPhone 不一样,生成的图露了底色。 在传统模式下,你得去读源码,改逻辑,调试。 在 Agent 模式下:

User: “生成的 iPad 图圆角太大了,iPad mini 的更直角一些。帮我修正脚本。”

Agent 的高光时刻:

- 自我诊断:它分析了代码,发现圆角是硬编码的

85px。 - 编写工具:它甚至写了一个临时的

analyze_bezel.py脚本,去像素级扫描边框素材,算出了精确的28px。 - 热更新 Skill:它修改了 Skill 的源码,引入了

DEVICE_CORNER_RADII字典。

Skill 成长了。 你的 AI 伙伴不仅会用工具,甚至会修工具。

📦 Step 4: 反哺 —— 从使用者到创造者

当你把这个 Skill 调教得无比顺手后,不要藏私。

User: “把修改后的代码和新做的 iPad 素材整理一下,我要提交回社区。”

Agent 会自动帮你把分散的修改(脚本、素材、文档)打包成一个干净的 skill_package。

这一刻,你完成了一次开源贡献的闭环,而全程你甚至没打开过 Finder。

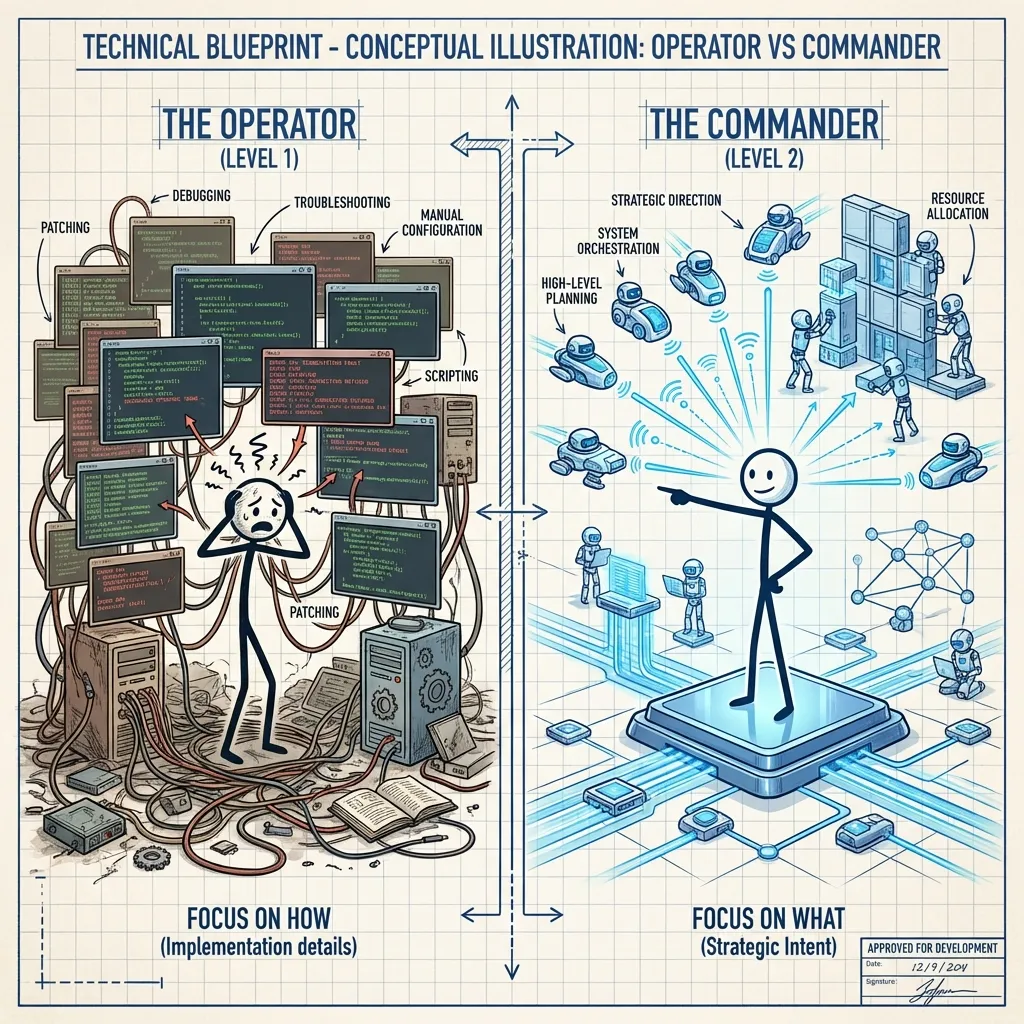

结语:做指挥官,而不是操作员

Google Antigravity 这样的环境,最大的价值不在于帮我们少敲几个字符。 它在于把开发者从繁琐的 “操作员” (Operator) 升格为 “指挥官” (Commander)。

- 不要问 “怎么配置这个参数?” —— 告诉它 “你要什么效果”。

- 不要手动

cdlscp—— 告诉它 “把 A 装到 B”。

下一次,当你面对一个繁琐的任务时,试着先问问你的 AI: “嘿,这事儿有没有 Skill 可以教你做?”

Powered by Agentic Logic